KI-gesteuerte Content-Moderation im März 2026: Die neuesten Entwicklungen

Die KI-gesteuerte Content-Moderation entwickelt sich rasant weiter und ist im März 2026 wichtiger denn je, um unsere digitalen Räume sicher zu halten. Von multimodalen Analysen bis hin zu komplexen LLMs – die Technologie verspricht, schädliche Inhalte effizienter zu erkennen und zu entfernen. Doch es gibt auch Herausforderungen: ethische Dilemmata, die Notwendigkeit menschlicher Expertise und der wachsende Druck durch Regulierungsbehörden prägen das aktuelle Bild. Erfahre, welche Fortschritte gemacht wurden und wohin die Reise geht.

Die digitale Welt ist ein faszinierender Ort, voller Möglichkeiten für Austausch und Information. Doch mit dieser Freiheit kommen auch Herausforderungen – von Hassreden und Desinformation bis hin zu extremistischem Content. Die schiere Menge an Inhalten, die täglich hochgeladen wird, überfordert menschliche Moderationsteams schon lange. Hier kommt die Künstliche Intelligenz ins Spiel, und im März 2026 sehen wir spannende neue Entwicklungen im Bereich der KI-gesteuerten Content-Moderation. Diese Technologien versprechen, unsere Online-Räume sicherer und angenehmer zu machen, indem sie schädliche Inhalte schneller und effizienter erkennen und entfernen. Doch wie weit sind wir wirklich? Welche Fortschritte wurden erzielt, und welche Hürden müssen noch überwunden werden? Tauchen wir ein in die neuesten Nachrichten rund um die KI-gesteuerte Content-Moderation.

Key Facts zur KI-gesteuerten Content-Moderation im März 2026

- Multimodale Ansätze sind auf dem Vormarsch: Moderne KI-Systeme beschränken sich nicht mehr nur auf Text. Sie analysieren auch Bilder, Videos und den Kontext ganzer Diskussionsstränge, um extremistische Inhalte präziser zu identifizieren.

- Reduzierung von Fehlalarmen: Durch verbesserte KI-Präzision können Fehlalarme im Content-Screening um bis zu 60 % reduziert werden, was die Effizienz menschlicher Moderationsteams erheblich steigert.

- Ethische Bedenken bleiben bestehen: Trotz technologischer Fortschritte gibt es weiterhin Diskussionen über potenzielle Voreingenommenheit in KI-Modellen und die Gefahr von Überzensur, wie Meta-CEO Mark Zuckerberg Anfang 2025 angedeutet hat.

- Regulierungsdruck nimmt zu: Regierungen weltweit, wie Kanada mit dem „Online Harms Act“ (Bill C-63), arbeiten an Gesetzen, die Social-Media-Plattformen stärker in die Pflicht nehmen sollen, schädliche Inhalte zu moderieren.

- Menschliche Expertise bleibt unerlässlich: Auch die fortschrittlichsten KI-Tools benötigen weiterhin menschliche Moderatoren, um komplexe Kontexte zu verstehen und die Feinheiten von sich ständig entwickelnder Sprache und Symbolik zu erfassen.

- Anstieg von Hassreden online: Eine besorgniserregende Entwicklung ist der Anstieg von Hassreden gegen bestimmte Bevölkerungsgruppen, wie z.B. gegen Südasiaten in Kanada, der online um über 1.350 Prozent von 2023 bis 2024 zugenommen hat.

- Transparenzberichte zeigen Umfang: Plattformen wie TikTok entfernen in der EU über 112 Millionen Videos, was den enormen Umfang der Moderationsaufgaben und den Einsatz von KI unterstreicht.

Die Evolution der KI in der Content-Moderation

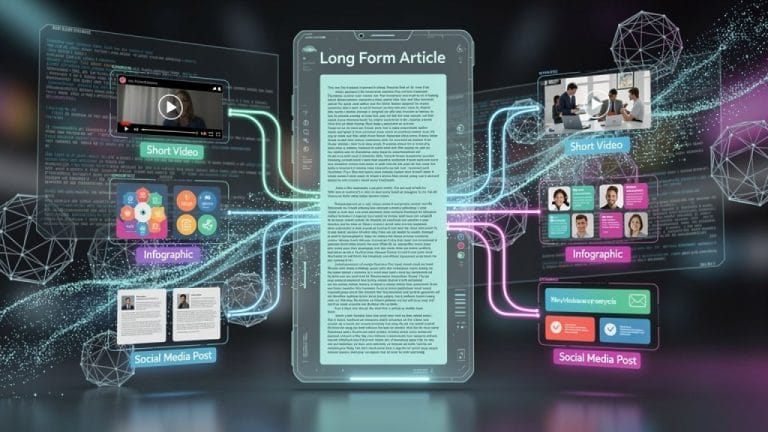

Die Anfänge der Content-Moderation waren mühsam und oft manuell. Menschen kämpften sich durch unzählige Beiträge, um Verstöße gegen Richtlinien zu finden. Mit dem Aufkommen von KI hat sich das Spielfeld dramatisch verändert. Zunächst waren es einfache Algorithmen, die auf Schlüsselwörter oder bekannte Muster reagierten. Doch extremistische Gruppen und Täter entwickelten schnell Wege, diese Systeme zu umgehen, indem sie ihre Sprache und Symbolik ständig anpassten. Heute sprechen wir von einer ganz anderen Liga: Großsprachmodelle (LLMs) und multimodale KI-Systeme, die nicht nur Text, sondern auch Bilder, Videos und den Kontext ganzer Konversationen analysieren können.

Ein vielversprechendes Beispiel ist der Multi-Modal Discussion Transformer (mDT), entwickelt von kanadischen Forschern der University of Waterloo. Dieses System ist darauf ausgelegt, die Nuancen von Sprache zu verstehen und extremistische Inhalte zu erkennen, die bewusst zweideutig formuliert sind. Statt einzelne Posts isoliert zu betrachten, integriert mDT Text, Bilder und Diskussionsstränge mithilfe von Graphtransformatoren. Das bedeutet, ein Kommentar wird im Zusammenhang mit dem gesamten Gesprächsverlauf interpretiert. Studien zeigen, dass dieser Ansatz die Erkennung extremistischer Inhalte deutlich verbessert und die Fehlerrate im Vergleich zu rein textbasierten Systemen reduziert. Während bestehende Social-Media-Plattformen oft noch auf ältere textbasierte Modelle wie BERT setzen, zeigt mDT einen Weg auf, wie KI die Komplexität von Online-Extremismus genauer erfassen kann. Diese Entwicklungen sind entscheidend, da Hassreden und extremistische Inhalte oft subtil sind und nicht immer explizite Drohungen enthalten, sondern eher implizite Gewaltandrohungen oder verschlüsselte Botschaften nutzen.

Herausforderungen und ethische Dilemmata

So beeindruckend die Fortschritte in der KI-gesteuerten Content-Moderation auch sind, sie bringen auch erhebliche Herausforderungen und ethische Fragen mit sich. Eines der größten Probleme sind Fehlalarme. Eine zu aggressive KI kann legitime Inhalte fälschlicherweise als schädlich einstufen und damit die Meinungsfreiheit einschränken. Meta-CEO Mark Zuckerberg äußerte sich Anfang 2025 kritisch über automatisierte Systeme, da diese „zu viele Fehler und zu viel Zensur“ verursachten. Solche Aussagen verdeutlichen das Spannungsfeld zwischen effektiver Moderation und der Wahrung der Meinungsfreiheit.

Ein weiteres sensibles Thema ist die Voreingenommenheit (Bias) in KI-Modellen. Wenn Trainingsdaten unzureichend oder voreingenommen sind, kann die KI bestimmte Gruppen oder Ausdrucksweisen unfairer behandeln. Dies kann dazu führen, dass Inhalte von Minderheiten oder marginalisierten Gruppen überproportional oft entfernt werden, während schädliche Inhalte anderer Gruppen unentdeckt bleiben. Die ständige Weiterentwicklung von extremistischer Sprache, Slang und Symbolen macht es für KI-Systeme extrem schwierig, immer auf dem neuesten Stand zu bleiben. Menschliche Moderatoren sind hier weiterhin unerlässlich, um den Kontext zu verstehen, neue Trends zu erkennen und die Feinheiten menschlicher Kommunikation zu interpretieren, die selbst die fortschrittlichsten Algorithmen noch nicht vollständig erfassen können. Die Kombination aus KI und menschlicher Expertise, ein hybrider Ansatz, wird daher oft als der vielversprechendste Weg angesehen.

Regulierung und Verantwortung der Plattformen

Angesichts der globalen Reichweite von Online-Plattformen und der potenziellen Auswirkungen von schädlichem Content rücken Regierungen und Regulierungsbehörden immer stärker in den Fokus. Im März 2026 sehen wir weltweit verstärkte Bemühungen, klare rechtliche Rahmenbedingungen für die Content-Moderation zu schaffen. Kanada hat beispielsweise den „Online Harms Act“ (Bill C-63) vorgestellt, der darauf abzielt, extremistische Inhalte online zu bekämpfen und Social-Media-Plattformen stärker in die Verantwortung zu nehmen. Auch in Deutschland gibt es das Netzwerkdurchsetzungsgesetz (NetzDG), das Plattformen dazu verpflichtet, „illegale Inhalte“ zu entfernen oder zu blockieren.

Solche Gesetze sollen Anreize schaffen, damit Plattformen proaktiver gegen schädliche Inhalte vorgehen. Denn aus Unternehmenssicht können Reputationsschäden und Werbekunden-Boykotte, die durch die Verbreitung von Hass und Extremismus entstehen, die kurzfristigen Vorteile durch virales Engagement überwiegen. Eine sicherere und inklusivere Online-Umgebung fördert langfristig die Nutzerbindung und damit das Geschäftsmodell der Plattformen. Es geht dabei nicht darum, Nutzer zu zensieren, sondern klare Rahmenbedingungen für extremistische Inhalte zu schaffen und die Rechenschaftspflicht der Unternehmen zu erhöhen. Die Entwicklung hin zu mehr Transparenz, wie sie TikTok mit seinen Berichten über entfernte Videos in der EU zeigt, ist ein wichtiger Schritt in diese Richtung.

Ausblick: KI-gesteuerte Content-Moderation im März 2026 und darüber hinaus

Die Landschaft der KI-gesteuerten Content-Moderation ist ständig in Bewegung, und der März 2026 zeigt uns, dass die Entwicklung rasant voranschreitet. Wir können davon ausgehen, dass multimodale Ansätze, die Text, Bild und Video in den Kontext stellen, weiter verfeinert werden. Die Forschung an Modellen wie mDT, die öffentlich zugänglich gemacht werden, fördert die kollaborative Entwicklung präziserer Tools. Das Ziel ist nicht, die menschliche Moderation vollständig zu ersetzen, sondern KI als leistungsstarken Verbündeten einzusetzen, der die Skalierung und Effizienz verbessert.

Ein entscheidender Faktor für die Zukunft wird die kontinuierliche Forschung in Bereichen wie der erklärbaren KI (XAI) sein. Wir müssen verstehen, warum eine KI eine bestimmte Moderationsentscheidung trifft, um Vertrauen aufzubauen und Voreingenommenheit zu minimieren. Die Integration von KI-gesteuerten Moderationslösungen in die Infrastruktur von Social-Media-Plattformen wird ebenfalls zunehmen, wobei der Fokus auf anpassbaren Workflows und der Reduzierung manueller Arbeit liegen wird. Es wird spannend zu sehen, wie sich die globale KI-Regulierung weiterentwickelt und welche Auswirkungen dies auf die Content-Moderation haben wird. Du kannst mehr über die aktuellen Entwicklungen in der KI-Regulierung in unserem Beitrag KI-Regulierung weltweit: Der Stand im März 2026 erfahren. Auch die Sicherheit von KI-Systemen selbst, wie im Artikel GPT-5 Safety: Red Teaming und Guardrails beschrieben, spielt eine immer größere Rolle, um Manipulationen und Missbrauch vorzubeugen.

Fazit

Die KI-gesteuerte Content-Moderation ist eine der entscheidendsten Technologien, um die Integrität und Sicherheit unserer digitalen Räume zu gewährleisten. Im März 2026 stehen wir an einem Punkt, an dem die Technologie immer ausgefeilter wird, von multimodalen Analysen bis hin zu kontextsensitiven LLMs. Sie bietet das Potenzial, die Flut schädlicher Inhalte einzudämmen und menschliche Moderatoren zu entlasten. Doch die Reise ist noch lange nicht zu Ende. Wir müssen weiterhin wachsam bleiben, die ethischen Implikationen sorgfältig abwägen und sicherstellen, dass KI-Systeme fair, transparent und im besten Interesse der Nutzer eingesetzt werden. Die Kombination aus fortschrittlicher KI, menschlicher Expertise und einem klaren regulatorischen Rahmen wird der Schlüssel sein, um die Online-Welt zu einem sichereren und produktiveren Ort für alle zu machen. Die Debatte um Balance und Verantwortung wird uns auch in den kommenden Monaten und Jahren begleiten, während die KI-gesteuerte Content-Moderation weiter reift und sich an neue Herausforderungen anpasst.

FAQ

Was sind die größten Fortschritte in der KI-gesteuerten Content-Moderation im März 2026?

Die größten Fortschritte liegen in multimodalen KI-Systemen, die nicht nur Text, sondern auch Bilder, Videos und den gesamten Kontext von Diskussionen analysieren. Modelle wie der Multi-Modal Discussion Transformer (mDT) zeigen eine verbesserte Erkennung von subtilen extremistischen Inhalten.

Welche Herausforderungen gibt es bei der KI-gesteuerten Content-Moderation?

Herausforderungen umfassen Fehlalarme, die Gefahr von Überzensur, die Voreingenommenheit (Bias) in KI-Modellen durch unzureichende Trainingsdaten und die ständige Anpassung extremistischer Sprache. Die menschliche Expertise bleibt für komplexe Kontexte und neue Trends unerlässlich.

Wie reagieren Regierungen auf die Entwicklungen in der KI-gesteuerten Content-Moderation?

Regierungen weltweit arbeiten an strengeren Regulierungen. Kanada hat den „Online Harms Act“ (Bill C-63) vorgestellt, und in Deutschland gibt es das NetzDG, die Social-Media-Plattformen stärker in die Pflicht nehmen, schädliche Inhalte zu moderieren.

Warum ist menschliche Moderation trotz KI weiterhin wichtig?

Menschliche Moderatoren sind entscheidend, um die Feinheiten menschlicher Kommunikation, sich entwickelnden Slang und Symbole sowie komplexe Kontexte zu verstehen, die KI-Systeme noch nicht vollständig erfassen können. Sie helfen, Fehlalarme zu reduzieren und Voreingenommenheit zu vermeiden.

Wie können Social-Media-Plattformen motiviert werden, in bessere KI-Moderation zu investieren?

Plattformen können durch Regulierungsdruck, den Schutz ihres Rufs und die Vermeidung finanzieller Verluste durch Werbekunden-Boykotte motiviert werden. Eine sicherere Umgebung fördert zudem langfristig die Nutzerbindung und damit das Geschäftsmodell.